构建语音智能体

某些传输层(例如默认的 OpenAIRealtimeWebRTC)会自动为您处理音频输入和输出。对于 OpenAIRealtimeWebSocket 等其他传输机制,您需要自行处理会话音频:

import { RealtimeAgent, RealtimeSession, TransportLayerAudio,} from '@openai/agents/realtime';

const agent = new RealtimeAgent({ name: 'My agent' });const session = new RealtimeSession(agent);const newlyRecordedAudio = new ArrayBuffer(0);

session.on('audio', (event: TransportLayerAudio) => { // play your audio});

// send new audio to the agentsession.sendAudio(newlyRecordedAudio);当底层传输机制支持时,session.muted 会报告当前静音状态,session.mute(true | false) 会切换麦克风采集。OpenAIRealtimeWebSocket 未实现静音:session.muted 返回 null,session.mute() 会抛出异常,因此在 WebSocket 设置中,您应在自己这一侧暂停采集,并在麦克风需要重新开启之前停止调用 sendAudio()。

在创建 RealtimeSession 时配置会话本身,通常通过 model 选项和 config 对象进行配置。connect(...) 用于连接时相关事项,例如凭据、端点 URL 和 SIP 呼叫附加,而不是任意会话字段。

import { RealtimeAgent, RealtimeSession } from '@openai/agents/realtime';

const agent = new RealtimeAgent({ name: 'Greeter', instructions: 'Greet the user with cheer and answer questions.',});

const session = new RealtimeSession(agent, { model: 'gpt-realtime-2', config: { outputModalities: ['audio'], reasoning: { effort: 'low', }, parallelToolCalls: true, audio: { input: { format: 'pcm16', transcription: { model: 'gpt-4o-mini-transcribe', }, }, output: { format: 'pcm16', }, }, },});在底层,SDK 会将此配置规范化为 Realtime session.update 形态。如果您需要某个在 RealtimeSessionConfig 中没有对应属性的原始会话字段,请使用 providerData,或通过 session.transport.sendEvent(...) 发送原始 session.update。

优先使用较新的 SDK 配置形态,其中包含 outputModalities、audio.input 和 audio.output。较旧的 SDK 别名(例如 modalities、inputAudioFormat、outputAudioFormat、inputAudioTranscription 和 turnDetection)仍会为了向后兼容而被规范化,但新代码应使用此处展示的嵌套 audio 结构。

对于具备推理能力的 Realtime 模型(例如 gpt-realtime-2),请在会话配置中设置 reasoning.effort。更高的推理强度可能会增加延迟和 token 使用量。当您想控制模型是否可以并行调用多个工具时,也可以设置 parallelToolCalls。

对于语音到语音会话,通常选择 outputModalities: ['audio'],这会提供音频输出和转写。仅当您需要纯文本响应时,才切换到 ['text']。

对于新增且在 RealtimeSessionConfig 中没有对应参数的参数,您可以使用 providerData。传入 providerData 的任何内容都会作为原始 session 对象的一部分转发。

您还可以在构造时设置的其他 RealtimeSession 选项:

| 选项 | 类型 | 用途 |

|---|---|---|

context | TContext | 合并到会话上下文中的额外本地上下文。 |

historyStoreAudio | boolean | 在本地历史快照中存储音频数据(默认禁用)。 |

outputGuardrails | RealtimeOutputGuardrail[] | 会话的输出护栏(请参见 护栏)。 |

outputGuardrailSettings | { debounceTextLength?: number } | 护栏运行节奏。默认为 100;使用 -1 表示仅在完整文本可用后运行一次。 |

tracingDisabled | boolean | 禁用会话的追踪。 |

groupId | string | 跨会话或后端运行对追踪进行分组。需要 workflowName。 |

traceMetadata | Record<string, any> | 附加到会话追踪的自定义元数据。需要 workflowName。 |

workflowName | string | 追踪工作流的友好名称。 |

automaticallyTriggerResponseForMcpToolCalls | boolean | 当 MCP 工具调用完成时自动触发模型响应(默认值:true)。 |

toolErrorFormatter | ToolErrorFormatter | 自定义返回给模型的工具审批拒绝消息。 |

connect(...) 选项:

| 选项 | 类型 | 用途 |

|---|---|---|

apiKey | string | (() => string | Promise<string>) | 此连接使用的 API 密钥(或惰性加载器)。 |

model | OpenAIRealtimeModels | string | 存在于传输层选项类型中。对于 RealtimeSession,请在构造函数中设置模型;原始传输也可以在连接时使用模型。 |

url | string | 可选的自定义 Realtime 端点 URL。 |

callId | string | 附加到现有的 SIP 发起的呼叫/会话。 |

对话生命周期

Section titled “对话生命周期”RealtimeSession 位于长期存在的 Realtime 连接之上。它会保留对话历史的本地副本,监听传输事件,运行工具和输出护栏,并让当前活动智能体配置与传输保持同步。

底层 API 行为仍然很重要:

- 成功连接会以

session.created事件开始,之后的配置变更会生成session.updated。 - 大多数会话属性都可以随时间变更,但

model不能在对话中途变更,voice只能在会话生成音频输出之前变更,并且追踪应在一开始确定,因为 Realtime API 不允许在启用后修改追踪。 - Realtime API 目前将单个会话限制为 60 分钟。

- 输入音频转写是异步的,因此最新话语的转写可能会在响应生成已开始后才到达。

在 SDK 层,await session.connect() 表示”传输已足够就绪,可以开始对话”,但具体时间点因传输机制而异:

- 在默认的浏览器 WebRTC 传输中,SDK 会在数据通道打开后立即发送初始

session.update,并尝试等待相应的session.updated事件后再解析connect()。这样做是为了避免音频在您的 instructions、tools 和 modalities 生效之前到达服务器。如果该确认始终未到达,connect()会在短暂超时后退而解析完成。 - 在默认的服务器端 WebSocket 传输中,

connect()会在套接字打开且初始配置发送后解析完成。因此,对应的session.updated事件可能会在connect()已解析后才到达。

如果您需要原始事件模型,请在阅读本页的同时参考官方 Realtime 对话指南。

轮次检测和语音活动检测

Section titled “轮次检测和语音活动检测”默认情况下,Realtime 会话使用内置的语音活动检测(VAD),使 API 能够判断用户何时开始或停止说话,以及何时创建响应。SDK 通过 audio.input.turnDetection 暴露此能力。

import { RealtimeSession } from '@openai/agents/realtime';import { agent } from './agent';

const session = new RealtimeSession(agent, { model: 'gpt-realtime-2', config: { audio: { input: { turnDetection: { type: 'semantic_vad', eagerness: 'medium', createResponse: true, interruptResponse: true, }, }, }, },});两种常见模式是:

semantic_vad,旨在实现更自然的轮次边界,并且当用户听起来还没说完时,可以稍微多等一会儿。server_vad,更偏向阈值驱动,并公开threshold、prefixPaddingMs、silenceDurationMs和idleTimeoutMs等设置。

如果您想自行管理轮次边界,请将 audio.input.turnDetection 设置为 null。官方 语音活动检测指南 和 Realtime 对话指南 更详细地描述了底层行为。

启用 VAD 时,在智能体说话时插话可能会中断当前响应。在 WebSocket 传输上,SDK 会监听 input_audio_buffer.speech_started,将助手音频截断到用户实际听到的位置,并发出 audio_interrupted 事件。当您在 WebSocket 设置中自行管理播放时,该事件尤其有用。

import { session } from './agent';

session.on('audio_interrupted', () => { // handle local playback interruption});如果您想公开一个手动停止按钮,请自行调用 interrupt():

import { session } from './agent';

session.interrupt();// this will still trigger the `audio_interrupted` event for you// to cut off the audio playback when using WebSocketsWebRTC 和 WebSocket 都会停止正在进行的响应,但底层机制因传输而异。WebRTC 会为您清除已缓冲的输出音频。在 WebSocket 设置中,您仍然需要自行停止本地播放,并且本地历史会在相应的截断和对话事件从传输返回时更新。

当您想将键入的输入或其他结构化用户内容发送到实时对话中时,请使用 sendMessage()。

import { RealtimeSession, RealtimeAgent } from '@openai/agents/realtime';

const agent = new RealtimeAgent({ name: 'Assistant',});

const session = new RealtimeSession(agent, { model: 'gpt-realtime-2',});

session.sendMessage('Hello, how are you?');这适用于文本与语音混合的 UI、带外上下文注入,或将语音输入与明确的键入澄清配对。

Realtime 语音到语音会话也可以包含图像。在 SDK 中,使用 addImage() 将图像附加到当前对话。

import { RealtimeAgent, RealtimeSession } from '@openai/agents/realtime';

const agent = new RealtimeAgent({ name: 'Assistant',});

const session = new RealtimeSession(agent, { model: 'gpt-realtime-2',});

const imageDataUrl = 'data:image/png;base64,...';

session.addImage(imageDataUrl, { triggerResponse: false });session.sendMessage('Describe what is in this image.');传入 triggerResponse: false 可让您先将图像与后续文本或音频轮次合并,再请求模型响应。这与官方 Realtime 对话图像输入指南 保持一致。

手动响应控制

Section titled “手动响应控制”在较高层的 SDK 层面,sendMessage() 和 addImage() 默认会为您触发响应。当您处理原始传输事件、按住说话流程,或自定义审核/验证步骤时,手动响应控制会很重要。

import { RealtimeAgent, RealtimeSession } from '@openai/agents/realtime';

const agent = new RealtimeAgent({ name: 'Greeter', instructions: 'Greet the user with cheer and answer questions.',});

const session = new RealtimeSession(agent, { model: 'gpt-realtime-2',});

session.transport.on('*', (event) => { // JSON parsed version of the event received on the connection});

// Send any valid event as JSON. For example triggering a new responsesession.transport.sendEvent({ type: 'response.create', // ...});有两种常见情况:

- 如果您通过

audio.input.turnDetection = null完全禁用 VAD,则需要负责提交音频轮次,然后发送response.create。 - 如果您保持 VAD 启用,但设置

turnDetection.interruptResponse = false和turnDetection.createResponse = false,API 仍会检测轮次,但会将响应创建交给您处理。

第二种模式适用于您想在模型响应之前检查或审核用户输入的场景。它与官方 Realtime 对话中关于禁用自动响应的指南一致。

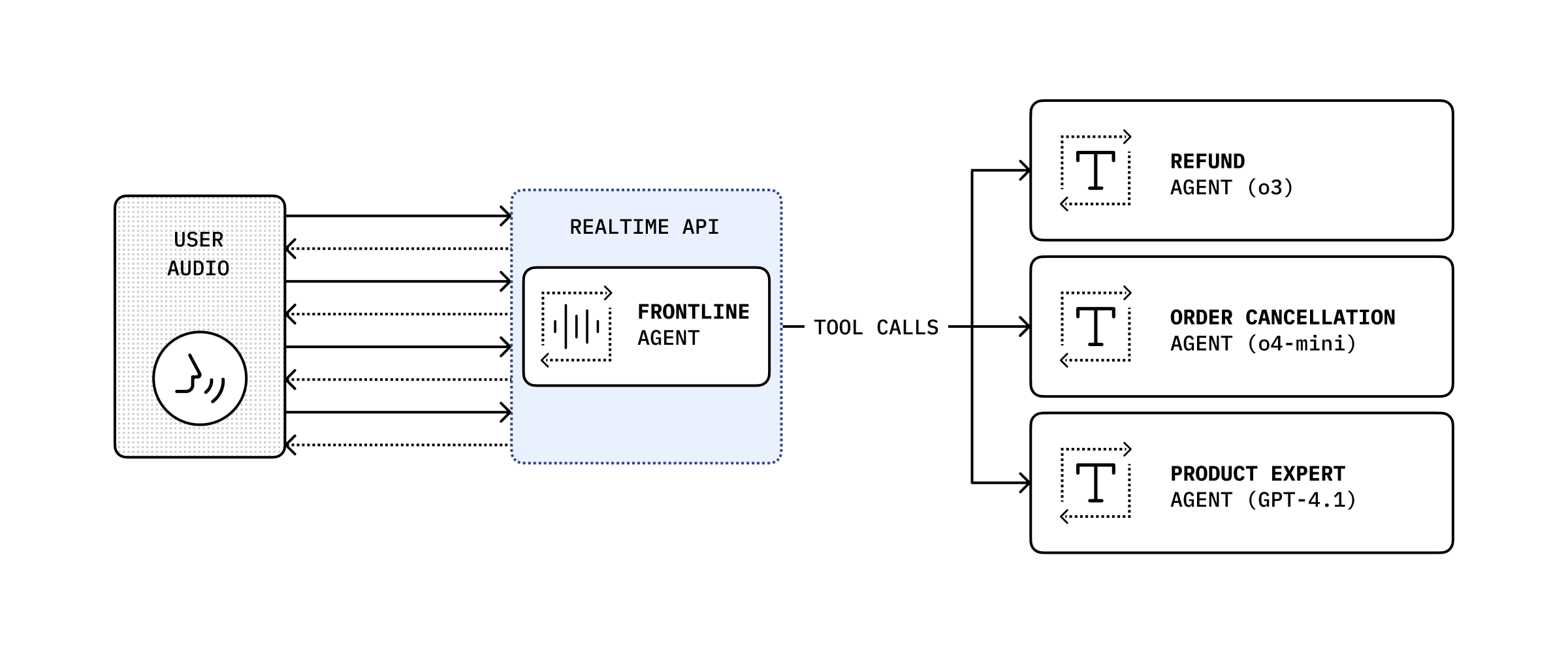

与常规智能体类似,您可以使用交接将智能体拆分为多个智能体,并在它们之间进行编排,以提升性能并更好地限定问题范围。

import { RealtimeAgent } from '@openai/agents/realtime';

const mathTutorAgent = new RealtimeAgent({ name: 'Math Tutor', handoffDescription: 'Specialist agent for math questions', instructions: 'You provide help with math problems. Explain your reasoning at each step and include examples',});

const agent = new RealtimeAgent({ name: 'Greeter', instructions: 'Greet the user with cheer and answer questions.', handoffs: [mathTutorAgent],});与常规智能体不同,交接在实时智能体中的行为略有不同。执行交接时,正在进行的会话会就地更新为新的智能体配置。因此,新智能体会自动访问正在进行的对话历史,并且输入过滤器目前不会应用。

由于会话保持实时状态,该会话的模型在交接期间不会变更。语音变更遵循底层 Realtime API 规则:它们仅在会话生成音频输出之前生效。实时交接主要用于在同一会话中切换 RealtimeAgent 配置;如果您需要使用不同模型(例如 gpt-5.4 这样的推理模型),或委托给非实时后端智能体,请使用通过工具委托。

与常规智能体一样,实时智能体可以调用工具来执行操作。Realtime 支持函数工具(本地执行)和托管 MCP 工具(由 Realtime API 远程执行)。您可以使用与常规智能体相同的 tool() 辅助函数来定义函数工具。

import { tool, RealtimeAgent } from '@openai/agents/realtime';import { z } from 'zod';

const getWeather = tool({ name: 'get_weather', description: 'Return the weather for a city.', parameters: z.object({ city: z.string() }), async execute({ city }) { return `The weather in ${city} is sunny.`; },});

const weatherAgent = new RealtimeAgent({ name: 'Weather assistant', instructions: 'Answer weather questions.', tools: [getWeather],});函数工具会在与您的 RealtimeSession 相同的环境中运行。这意味着,如果您的会话在浏览器中运行,工具也会在浏览器中执行。如果您需要执行敏感操作,请在工具内部调用您的后端,并让服务器执行需要权限的工作。

这使浏览器端工具可以充当通往服务器端逻辑的轻量级辅助通道。例如,examples/realtime-next 在浏览器中定义了一个 refundBackchannel 工具,该工具会将请求和当前对话历史转发到服务器上的 handleRefundRequest(...),在那里,一个单独的 Runner 可以使用不同的智能体或模型来评估退款,再将结果返回给语音会话。

托管 MCP 工具

Section titled “托管 MCP 工具”托管 MCP 工具可以通过 hostedMcpTool 配置,并会远程执行。当 MCP 工具可用性发生变化时,会话会发出 mcp_tools_changed。若要防止会话在 MCP 工具调用完成后自动触发模型响应,请设置 automaticallyTriggerResponseForMcpToolCalls: false。

当前经过过滤的 MCP 工具列表也可通过 session.availableMcpTools 获取。该属性和 mcp_tools_changed 事件都只反映当前活动智能体上启用的托管 MCP 服务器,并且会应用智能体配置中的任何 allowed_tools 过滤器。

如果您将安全的服务器选择、headers 和审批视为连接前配置,托管 MCP 设置最容易理解。在 RealtimeSession.connect() 打开传输之前,SDK 会解析当前活动智能体的托管 MCP 工具定义,并将受支持的 MCP 字段包含在发送给 Realtime API 的初始会话配置中。

这个时机在浏览器 WebRTC 应用中最为重要。临时客户端密钥始终在您的服务器上生成,因此任何必须保密的托管 MCP 凭据或自定义 headers 都应作为初始 session 载荷的一部分,附加到服务器端的 POST /v1/realtime/client_secrets 请求中。不要将长期有效的凭据放入浏览器代码,并计划在 connect() 开始后再添加它们。

在 Realtime API 层面,后续的 session.update 调用仍然可以更改工具和其他可变会话字段,并且 SDK 本身会在当前活动智能体变更时发送 session.update。不过,在浏览器应用中,您应将安全的托管 MCP 初始化视为服务器端、连接前事项,并让浏览器端 RealtimeSession 配置与服务器生成的内容保持一致。

工具执行期间,智能体将无法处理来自用户的新请求。改善体验的一种方式是让您的智能体在即将执行工具时进行说明,或说出特定短语,为智能体争取一些时间来执行工具。

如果某个函数工具应在不立即触发另一个模型响应的情况下完成,请从 @openai/agents/realtime 返回 backgroundResult(output)。这会将工具输出发回会话,同时让响应触发仍由您控制。

函数工具超时选项(timeoutMs、timeoutBehavior、timeoutErrorFunction)在 Realtime 会话中的工作方式相同。使用默认的 error_as_result 时,超时消息会作为工具输出发送。使用 raise_exception 时,会话会发出包含 ToolTimeoutError 的 error 事件,并且不会为该调用发送工具输出。

对话历史访问

Section titled “对话历史访问”除了智能体调用特定工具时传入的参数之外,您还可以访问由 Realtime Session 跟踪的当前对话历史快照。如果您需要根据对话当前状态执行更复杂的操作,或计划使用通过工具进行委托,这会很有用。

import { tool, RealtimeContextData, RealtimeItem,} from '@openai/agents/realtime';import { z } from 'zod';

const parameters = z.object({ request: z.string(),});

const refundTool = tool<typeof parameters, RealtimeContextData>({ name: 'Refund Expert', description: 'Evaluate a refund', parameters, execute: async ({ request }, details) => { // The history might not be available const history: RealtimeItem[] = details?.context?.history ?? []; // making your call to process the refund request },});工具执行前审批

Section titled “工具执行前审批”如果您使用 needsApproval: true 定义工具,智能体会在执行该工具前发出 tool_approval_requested 事件。

通过监听此事件,您可以向用户展示 UI,以批准或拒绝该工具调用。

使用 await session.approve(request.approvalItem) 或 await session.reject(request.approvalItem) 来解决该请求。对于函数工具,您可以传入 { alwaysApprove: true } 或 { alwaysReject: true },以在会话剩余期间对重复调用复用相同决策;也可以使用 session.reject(request.approvalItem, { message: '...' }) 为该特定调用向模型返回自定义拒绝消息。托管 MCP 审批不支持持久批准/拒绝;请改用托管 MCP allowedTools 配置来限制这些工具。

如果您没有传入按调用设置的拒绝 message,会话会回退到 toolErrorFormatter(如果已配置),然后回退到 SDK 默认拒绝文本。

import { session } from './agent';

session.on('tool_approval_requested', (_context, _agent, request) => { // show a UI to the user to approve or reject the tool call // you can use the `session.approve(...)` or `session.reject(...)` methods to approve or reject the tool call

session.approve(request.approvalItem); // or session.reject(request.approvalItem);});护栏提供一种方式,用于监控智能体所说的内容是否违反一组规则,并立即切断响应。这些检查会针对智能体响应的转写流运行。在音频会话中,SDK 使用输出音频转写和转写增量,因此重要的前提是转写可用性,而不是单独的文本输出模态。

您提供的护栏会在模型响应返回时异步运行,使您可以基于预定义的分类触发条件切断响应,例如”提到了某个特定的禁用词”。

当护栏被触发时,会话会发出 guardrail_tripped 事件。该事件还会提供一个 details 对象,其中包含触发护栏的 itemId。

import { RealtimeOutputGuardrail, RealtimeAgent, RealtimeSession,} from '@openai/agents/realtime';

const agent = new RealtimeAgent({ name: 'Greeter', instructions: 'Greet the user with cheer and answer questions.',});

const guardrails: RealtimeOutputGuardrail[] = [ { name: 'No mention of Dom', async execute({ agentOutput }) { const domInOutput = agentOutput.includes('Dom'); return { tripwireTriggered: domInOutput, outputInfo: { domInOutput }, }; }, },];

const guardedSession = new RealtimeSession(agent, { outputGuardrails: guardrails,});默认情况下,护栏每 100 个字符运行一次,并在最终转写可用时再次运行。由于说出文本通常比生成转写耗时更长,这通常能让护栏在用户听到不安全输出之前将其切断。

如果您想修改此行为,可以向会话传入一个 outputGuardrailSettings 对象。

当您只想在响应结束时对完整生成的转写评估一次,请设置 debounceTextLength: -1。

import { RealtimeAgent, RealtimeSession } from '@openai/agents/realtime';

const agent = new RealtimeAgent({ name: 'Greeter', instructions: 'Greet the user with cheer and answer questions.',});

const guardedSession = new RealtimeSession(agent, { outputGuardrails: [ /*...*/ ], outputGuardrailSettings: { debounceTextLength: 500, // run guardrail every 500 characters or set it to -1 to run it only at the end },});对话状态和委托

Section titled “对话状态和委托”对话历史管理

Section titled “对话历史管理”RealtimeSession 会自动维护一个本地 history 快照,用于跟踪用户消息、助手输出、工具调用和截断状态。您可以在 UI 中渲染它,在工具内部检查它,或在需要纠正或移除条目时更新它。

随着对话变化,会话会发出 history_updated。如果您需要请求历史更改,请使用 updateHistory()。它会要求传输对当前历史进行差异比较,并发送必要的删除/创建事件;当相应的对话事件从传输返回时,本地 session.history 视图会更新。

import { RealtimeSession, RealtimeAgent } from '@openai/agents/realtime';

const agent = new RealtimeAgent({ name: 'Assistant',});

const session = new RealtimeSession(agent, { model: 'gpt-realtime-2',});

await session.connect({ apiKey: '<client-api-key>' });

// listening to the history_updated eventsession.on('history_updated', (history) => { // returns the full history of the session console.log(history);});

// Option 1: explicit settingsession.updateHistory([ /* specific history */]);

// Option 2: override based on current state like removing all agent messagessession.updateHistory((currentHistory) => { return currentHistory.filter( (item) => !(item.type === 'message' && item.role === 'assistant'), );});- 目前您无法事后编辑函数工具调用。

- 历史中的助手文本取决于可用的转写,包括

output_audio.transcript。 - 被中断截断的响应不会保留最终转写。

- 最好将输入音频转写视为对用户所说内容的粗略参考,而不是模型如何解读音频的精确副本。

通过工具委托

Section titled “通过工具委托”

通过将对话历史与工具调用结合,您可以将对话委托给另一个后端智能体来执行更复杂的操作,然后将其作为结果返回给用户。

import { RealtimeAgent, RealtimeContextData, tool,} from '@openai/agents/realtime';import { handleRefundRequest } from './serverAgent';import z from 'zod';

const refundSupervisorParameters = z.object({ request: z.string(),});

const refundSupervisor = tool< typeof refundSupervisorParameters, RealtimeContextData>({ name: 'escalateToRefundSupervisor', description: 'Escalate a refund request to the refund supervisor', parameters: refundSupervisorParameters, execute: async ({ request }, details) => { // This will execute on the server return handleRefundRequest(request, details?.context?.history ?? []); },});

const agent = new RealtimeAgent({ name: 'Customer Support', instructions: 'You are a customer support agent. If you receive any requests for refunds, you need to delegate to your supervisor.', tools: [refundSupervisor],});下面的代码随后在服务器上运行,在此示例中通过 Next.js Server Action 运行。

// This runs on the serverimport 'server-only';

import { Agent, run } from '@openai/agents';import type { RealtimeItem } from '@openai/agents/realtime';import z from 'zod';

const agent = new Agent({ name: 'Refund Expert', instructions: 'You are a refund expert. You are given a request to process a refund and you need to determine if the request is valid.', model: 'gpt-5.4', outputType: z.object({ reasong: z.string(), refundApproved: z.boolean(), }),});

export async function handleRefundRequest( request: string, history: RealtimeItem[],) { const input = `The user has requested a refund.

The request is: ${request}

Current conversation history:${JSON.stringify(history, null, 2)}`.trim();

const result = await run(agent, input);

return JSON.stringify(result.finalOutput, null, 2);}