音声エージェントの概要

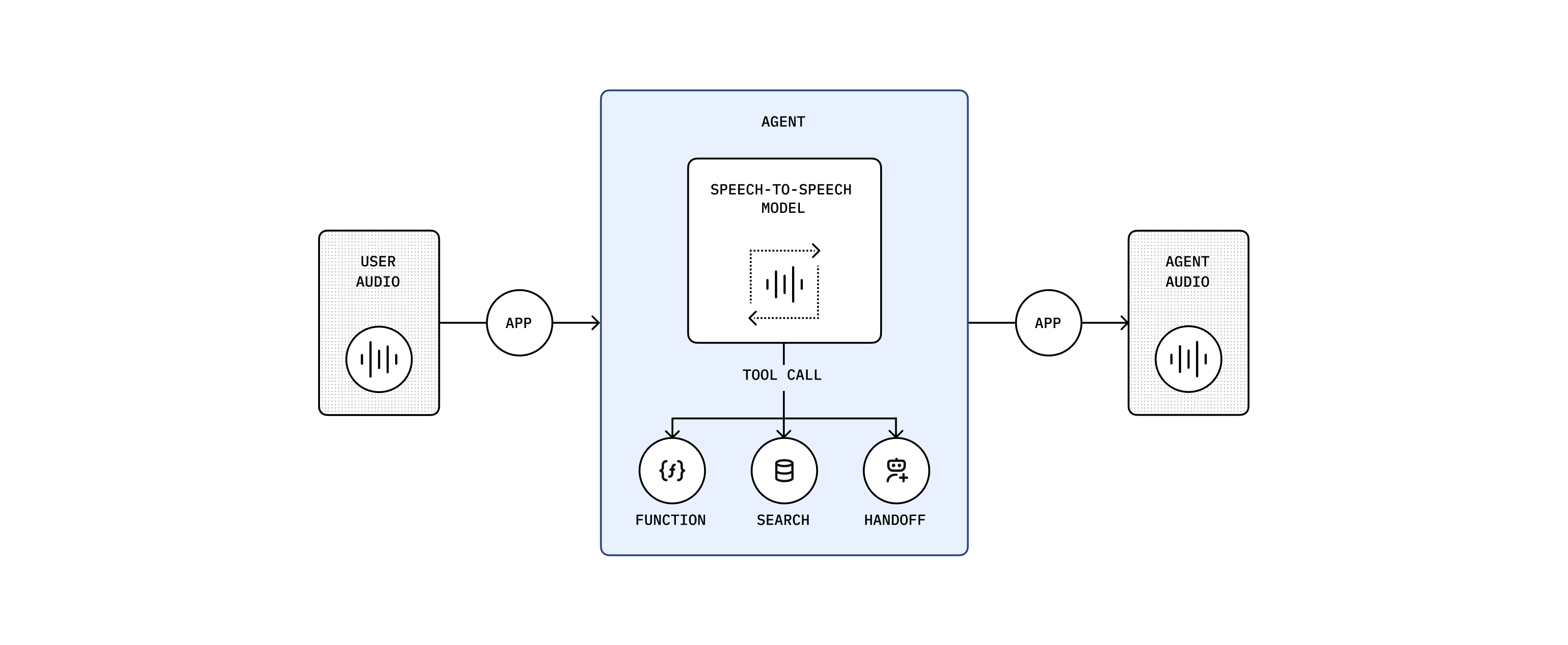

音声エージェントを使うと、 OpenAI の speech-to-speech モデル上に低レイテンシな音声インターフェースを構築できます。 SDK は Realtime API のメンタルモデルをそのまま維持しつつ、 元のイベントフローを RealtimeAgent 、 RealtimeSession 、およびトランスポートヘルパーでラップし、ツール、ガードレール、ハンドオフ、セッション履歴をより扱いやすくします。

内部では、公式ガイドの Realtime API with WebRTC、 Realtime conversations、および voice activity detection にある同じ Realtime の概念が引き続き適用されます。 Voice Agents SDK はその API の上に TypeScript ファーストのレイヤーを追加するため、トランスポートやイベント処理をゼロから作り直すのではなく、製品ロジックに集中できます。

クイックスタート OpenAI Agents SDK を使って、ほんの数分ではじめてのエージェントをつくることができます。

音声エージェントの構築 SDK におけるセッションライフサイクル、 VAD、割り込み、マルチモーダル入力、ツール、履歴の仕組みを学びます。

リアルタイムトランスポート WebRTC、 WebSocket、 SIP、またはカスタムトランスポートから選択し、どのタイミングで元のイベントに移行すべきかを把握します。

SDK の追加機能

Section titled “SDK の追加機能”- エフェメラルクライアントトークンを使った、ブラウザファーストな WebRTC セットアップ

- サーバーサイドの WebSocket および SIP トランスポートオプション

- 自動的な割り込み処理とローカル会話履歴の更新

- リアルタイムなハンドオフによるマルチエージェントオーケストレーション

- 関数ツール、 hosted MCP ツール、承認、および委任パターン

- ライブ音声インタラクション向けの出力ガードレールとトレーシングのサポート

次に読むページ

Section titled “次に読むページ”| 必要なこと | 参照先 |

|---|---|

| WebRTC とエフェメラルトークンを使ってブラウザクライアントを安全に接続する | クイックスタート |

| セッションライフサイクル、 VAD、割り込み、画像入力、ツール、履歴を理解する | 音声エージェントの構築 |

| WebRTC、 WebSocket、 SIP、カスタムトランスポートのどれを使うか決める | リアルタイムトランスポート |

| Twilio 上で電話やテレフォニー体験を実行する | Twilio 上の Realtime Agent |

| Cloudflare Workers やその他の workerd ランタイムから接続する | Cloudflare 上の Realtime Agent |

speech-to-speech を選ぶ理由

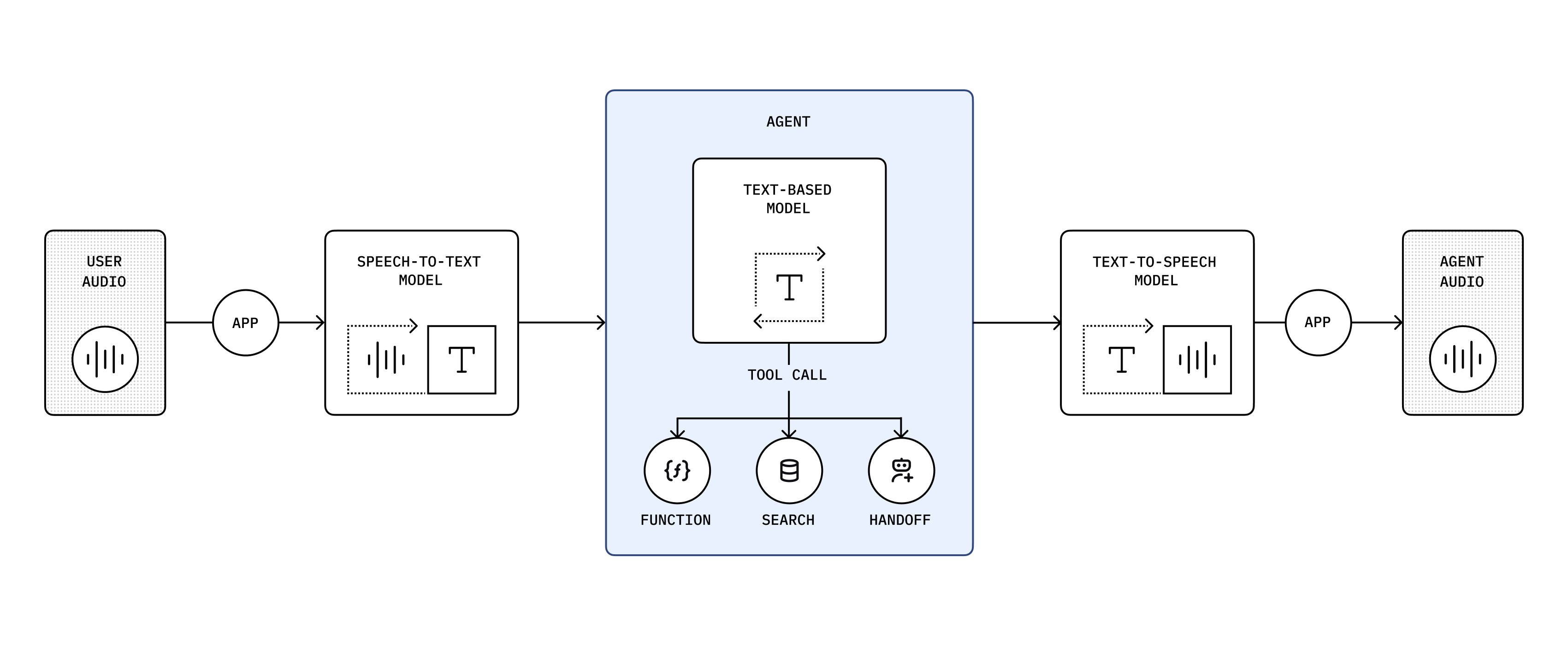

Section titled “speech-to-speech を選ぶ理由”speech-to-speech モデルはユーザーの音声を直接処理するため、各ターンごとに speech-to-text、テキスト推論、 text-to-speech の個別チェーンを構築する必要がありません。 これによりレイテンシが抑えられ、リアルタイムアプリケーションにおいて割り込み、テキストと音声が混在する入力、ツール呼び出しがより自然に感じられます。