音声エージェントの構築

セッションのセットアップ

Section titled “セッションのセットアップ”デフォルトの OpenAIRealtimeWebRTC のような一部のトランスポート層は、音声入出力を自動で処理します。OpenAIRealtimeWebSocket のようなその他のトランスポート機構では、セッションの音声を自分で処理する必要があります:

import { RealtimeAgent, RealtimeSession, TransportLayerAudio,} from '@openai/agents/realtime';

const agent = new RealtimeAgent({ name: 'My agent' });const session = new RealtimeSession(agent);const newlyRecordedAudio = new ArrayBuffer(0);

session.on('audio', (event: TransportLayerAudio) => { // play your audio});

// send new audio to the agentsession.sendAudio(newlyRecordedAudio);基盤となるトランスポートが対応している場合、session.muted は現在のミュート状態を報告し、session.mute(true | false) はマイクキャプチャを切り替えます。OpenAIRealtimeWebSocket はミュートを実装していません。session.muted は null を返し、session.mute() は例外をスローするため、WebSocket 構成では自分側でキャプチャを一時停止し、マイクを再び有効にすべきタイミングまで sendAudio() の呼び出しを停止してください。

セッション設定

Section titled “セッション設定”RealtimeSession を作成するときに、通常は model オプションと config オブジェクトを通じてセッション自体を設定します。connect(...) は、任意のセッションフィールドではなく、認証情報、エンドポイント URL、SIP コールのアタッチなど、接続時の関心事のためのものです。

import { RealtimeAgent, RealtimeSession } from '@openai/agents/realtime';

const agent = new RealtimeAgent({ name: 'Greeter', instructions: 'Greet the user with cheer and answer questions.',});

const session = new RealtimeSession(agent, { model: 'gpt-realtime-2', config: { outputModalities: ['audio'], reasoning: { effort: 'low', }, parallelToolCalls: true, audio: { input: { format: 'pcm16', transcription: { model: 'gpt-4o-mini-transcribe', }, }, output: { format: 'pcm16', }, }, },});内部では、SDK はこの設定を Realtime session.update 形式に正規化します。RealtimeSessionConfig に対応するプロパティがない元のセッションフィールドが必要な場合は、providerData を使用するか、session.transport.sendEvent(...) を通じて元の session.update を送信してください。

outputModalities、audio.input、audio.output を使う新しい SDK 設定形式を優先してください。modalities、inputAudioFormat、outputAudioFormat、inputAudioTranscription、turnDetection などの古い SDK エイリアスは後方互換性のため引き続き正規化されますが、新しいコードではここに示すネストされた audio 構造を使用するべきです。

gpt-realtime-2 など、推論対応の Realtime モデルでは、セッション設定で reasoning.effort を設定します。推論の effort が高いほど、レイテンシとトークン使用量が増える可能性があります。モデルが複数のツールを並列で呼び出せるかどうかを制御したい場合は、parallelToolCalls も設定できます。

speech-to-speech セッションでは、通常は outputModalities: ['audio'] を選択します。これにより、音声出力と文字起こしが得られます。テキストのみの応答が必要な場合にだけ ['text'] に切り替えてください。

新しく、RealtimeSessionConfig に対応するパラメーターがないパラメーターについては、providerData を使用できます。providerData に渡されたものはすべて、元の session オブジェクトの一部として転送されます。

構築時に設定できる追加の RealtimeSession オプション:

| オプション | 型 | 目的 |

|---|---|---|

context | TContext | セッションコンテキストにマージされる追加のローカルコンテキスト。 |

historyStoreAudio | boolean | ローカル履歴スナップショットに音声データを保存します(デフォルトでは無効)。 |

outputGuardrails | RealtimeOutputGuardrail[] | セッションの出力ガードレール(Guardrails を参照)。 |

outputGuardrailSettings | { debounceTextLength?: number } | ガードレールの実行間隔。デフォルトは 100 です。完全なテキストが利用可能になった時点で一度だけ実行するには -1 を使用します。 |

tracingDisabled | boolean | セッションのトレーシングを無効化します。 |

groupId | string | セッションやバックエンド実行にまたがってトレースをグループ化します。workflowName が必要です。 |

traceMetadata | Record<string, any> | セッショントレースに添付するカスタムメタデータ。workflowName が必要です。 |

workflowName | string | トレースワークフローのわかりやすい名前。 |

automaticallyTriggerResponseForMcpToolCalls | boolean | MCP ツール呼び出しが完了したときにモデル応答を自動トリガーします(デフォルト: true)。 |

toolErrorFormatter | ToolErrorFormatter | モデルに返されるツール承認拒否メッセージをカスタマイズします。 |

connect(...) オプション:

| オプション | 型 | 目的 |

|---|---|---|

apiKey | string | (() => string | Promise<string>) | この接続で使用する API キー(または遅延ローダー)。 |

model | OpenAIRealtimeModels | string | トランスポートレベルのオプション型に存在します。RealtimeSession では、コンストラクターでモデルを設定してください。元のトランスポートでも、接続時にモデルを使用できます。 |

url | string | 任意のカスタム Realtime エンドポイント URL。 |

callId | string | 既存の SIP 起点のコール / セッションにアタッチします。 |

会話のライフサイクル

Section titled “会話のライフサイクル”RealtimeSession は、長時間維持される Realtime 接続の上に位置します。会話履歴のローカルコピーを保持し、トランスポートイベントをリッスンし、ツールと出力ガードレールを実行し、アクティブなエージェント設定をトランスポートと同期し続けます。

基盤となる API の挙動も依然として重要です:

- 接続が成功すると

session.createdイベントから始まり、その後の設定変更によりsession.updatedが生成されます。 - ほとんどのセッションプロパティは時間の経過とともに変更できますが、

modelは会話の途中で変更できず、voiceはセッションが音声出力を生成する前にのみ変更できます。また、Realtime API ではトレーシングを有効にした後に変更できないため、トレーシングは最初に決めておく必要があります。 - Realtime API は現在、単一セッションを 60 分に制限しています。

- 入力音声の文字起こしは非同期のため、最新の発話の文字起こしは、応答生成がすでに開始された後に到着する場合があります。

SDK レイヤーでは、await session.connect() は「トランスポートが会話を開始できるだけの準備ができた」ことを意味しますが、正確な時点はトランスポートによって異なります:

- デフォルトのブラウザー WebRTC トランスポートでは、SDK はデータチャネルが開くとすぐに初期

session.updateを送信し、対応するsession.updatedイベントを待ってからconnect()を解決しようとします。これは、instructions、tools、modalities が適用される前に音声がサーバーへ届くのを避けるためです。その確認応答が届かない場合、connect()は短いタイムアウト後に解決するフォールバックを行います。 - デフォルトのサーバー側 WebSocket トランスポートでは、ソケットが開き、初期設定が送信されると

connect()が解決します。そのため、対応するsession.updatedイベントはconnect()がすでに解決した後に到着する場合があります。

元のイベントモデルが必要な場合は、このページとあわせて公式の Realtime 会話ガイド を参照してください。

インタラクションフロー

Section titled “インタラクションフロー”ターン検出と音声アクティビティ検出

Section titled “ターン検出と音声アクティビティ検出”デフォルトでは、Realtime セッションは組み込みの音声アクティビティ検出(VAD)を使用するため、API はユーザーが話し始めた、または話し終えたタイミングと、応答を作成するタイミングを判断できます。SDK はこれを audio.input.turnDetection を通じて公開します。

import { RealtimeSession } from '@openai/agents/realtime';import { agent } from './agent';

const session = new RealtimeSession(agent, { model: 'gpt-realtime-2', config: { audio: { input: { turnDetection: { type: 'semantic_vad', eagerness: 'medium', createResponse: true, interruptResponse: true, }, }, }, },});一般的なモードは 2 つあります:

semantic_vadは、より自然なターン境界を目指し、ユーザーがまだ話し終えていないように聞こえる場合には少し長く待つことができます。server_vadは、しきい値駆動の傾向が強く、threshold、prefixPaddingMs、silenceDurationMs、idleTimeoutMsなどの設定を公開します。

ターン境界を自分で管理したい場合は、audio.input.turnDetection を null に設定します。公式の 音声アクティビティ検出ガイド と Realtime 会話ガイド では、基盤となる挙動をより詳しく説明しています。

VAD が有効な場合、エージェントにかぶせて話すと、現在の応答を割り込めます。WebSocket トランスポートでは、SDK は input_audio_buffer.speech_started をリッスンし、ユーザーが実際に聞いたところまでアシスタント音声を切り詰め、audio_interrupted イベントを発行します。このイベントは、WebSocket 構成で自分で再生を管理する場合に特に便利です。

import { session } from './agent';

session.on('audio_interrupted', () => { // handle local playback interruption});手動停止ボタンを公開したい場合は、自分で interrupt() を呼び出してください:

import { session } from './agent';

session.interrupt();// this will still trigger the `audio_interrupted` event for you// to cut off the audio playback when using WebSocketsWebRTC と WebSocket はどちらも進行中の応答を停止しますが、低レベルの仕組みはトランスポートによって異なります。WebRTC はバッファー済みの出力音声を自動でクリアします。WebSocket 構成では、ローカル再生を自分で停止する必要があり、対応する切り詰めイベントと会話イベントがトランスポートから戻ってきたときにローカル履歴が更新されます。

テキスト入力

Section titled “テキスト入力”sendMessage() は、入力したテキストや追加の構造化されたユーザーコンテンツをライブ会話へ送信したい場合に使用します。

import { RealtimeSession, RealtimeAgent } from '@openai/agents/realtime';

const agent = new RealtimeAgent({ name: 'Assistant',});

const session = new RealtimeSession(agent, { model: 'gpt-realtime-2',});

session.sendMessage('Hello, how are you?');これは、テキストと音声が混在する UI、アウトオブバンドのコンテキスト注入、または音声入力に明示的なテキスト入力による補足説明を組み合わせる場合に便利です。

Realtime speech-to-speech セッションには画像も含められます。SDK では、addImage() を使用して現在の会話に画像を添付します。

import { RealtimeAgent, RealtimeSession } from '@openai/agents/realtime';

const agent = new RealtimeAgent({ name: 'Assistant',});

const session = new RealtimeSession(agent, { model: 'gpt-realtime-2',});

const imageDataUrl = 'data:image/png;base64,...';

session.addImage(imageDataUrl, { triggerResponse: false });session.sendMessage('Describe what is in this image.');triggerResponse: false を渡すと、モデルに応答を求める前に、画像を後続のテキストまたは音声ターンとまとめられます。これは公式の Realtime 会話の画像入力ガイダンス と一致します。

手動レスポンス制御

Section titled “手動レスポンス制御”上位の SDK レイヤーでは、sendMessage() と addImage() はデフォルトで応答をトリガーします。元のトランスポートイベント、プッシュトゥトークフロー、またはカスタムのモデレーション / 検証ステップを扱う場合、手動の応答制御が重要になります。

import { RealtimeAgent, RealtimeSession } from '@openai/agents/realtime';

const agent = new RealtimeAgent({ name: 'Greeter', instructions: 'Greet the user with cheer and answer questions.',});

const session = new RealtimeSession(agent, { model: 'gpt-realtime-2',});

session.transport.on('*', (event) => { // JSON parsed version of the event received on the connection});

// Send any valid event as JSON. For example triggering a new responsesession.transport.sendEvent({ type: 'response.create', // ...});一般的なケースは 2 つあります:

audio.input.turnDetection = nullで VAD を完全に無効化した場合、音声ターンをコミットし、その後response.createを送信する責任があります。- VAD を有効なままにしつつ、

turnDetection.interruptResponse = falseとturnDetection.createResponse = falseを設定した場合、API は引き続きターンを検出しますが、応答作成はあなたに任せます。

この 2 つ目のパターンは、モデルが応答する前にユーザー入力を検査またはモデレーションしたい場合に便利です。これは公式の 自動応答の無効化に関する Realtime 会話ガイダンス と一致します。

エージェント機能

Section titled “エージェント機能”通常のエージェントと同様に、ハンドオフを使用してエージェントを複数のエージェントに分割し、それらの間をオーケストレーションすることで、性能を向上させ、問題のスコープをより適切に限定できます。

import { RealtimeAgent } from '@openai/agents/realtime';

const mathTutorAgent = new RealtimeAgent({ name: 'Math Tutor', handoffDescription: 'Specialist agent for math questions', instructions: 'You provide help with math problems. Explain your reasoning at each step and include examples',});

const agent = new RealtimeAgent({ name: 'Greeter', instructions: 'Greet the user with cheer and answer questions.', handoffs: [mathTutorAgent],});通常のエージェントとは異なり、リアルタイムエージェントではハンドオフの挙動が少し異なります。ハンドオフが実行されると、進行中のセッションが新しいエージェント設定でその場で更新されます。このため、新しいエージェントは進行中の会話履歴に自動的にアクセスでき、入力フィルターは現在適用されません。

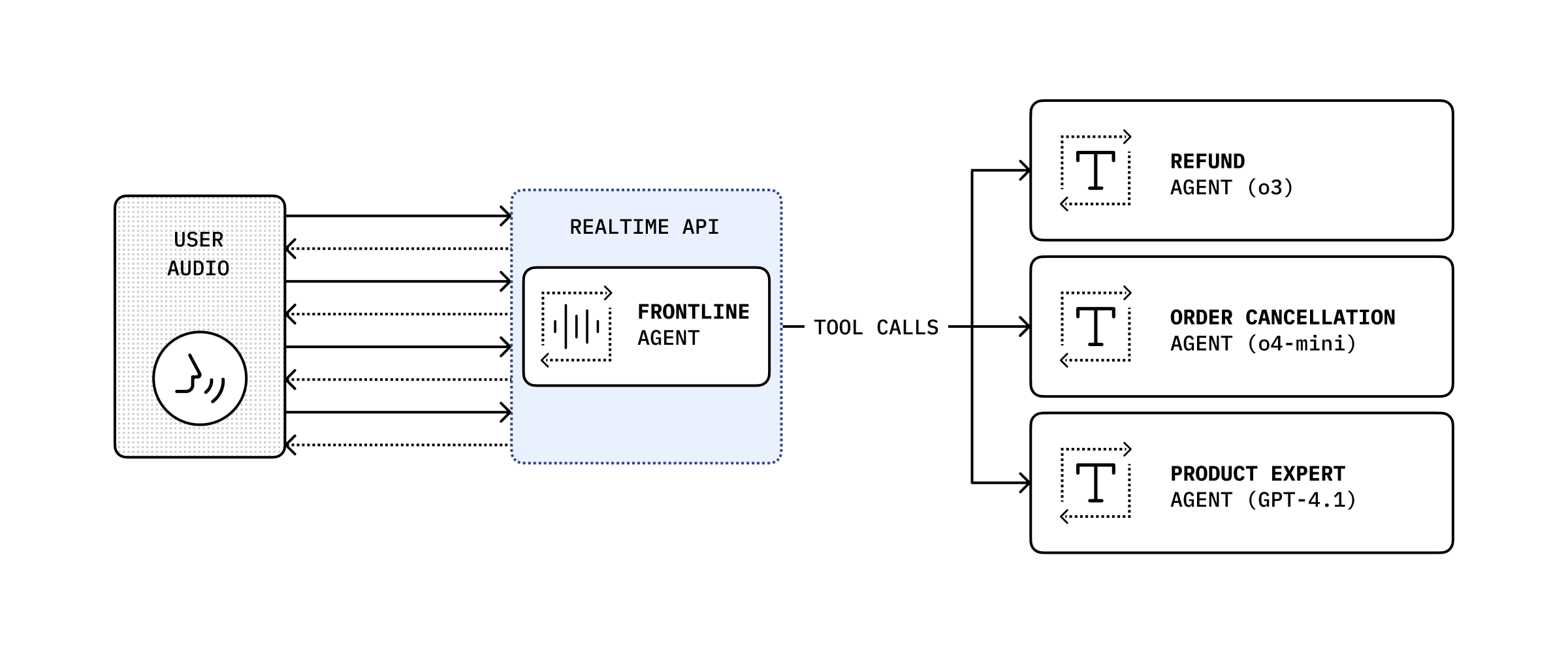

セッションはライブのまま維持されるため、そのセッションのモデルはハンドオフ中に変わりません。voice の変更は、基盤となる Realtime API のルールに従います。つまり、セッションが音声出力を生成する前にのみ機能します。Realtime のハンドオフは主に、同じセッション上の RealtimeAgent 設定を切り替えるためのものです。別のモデル、たとえば gpt-5.4 のような推論モデルを使用する必要がある場合や、非リアルタイムのバックエンドエージェントへ委任する必要がある場合は、delegation through tools を使用してください。

通常のエージェントと同様に、リアルタイムエージェントはツールを呼び出してアクションを実行できます。Realtime は 関数ツール (ローカルで実行)と Hosted MCP ツール (Realtime API によってリモートで実行)をサポートします。通常のエージェントで使うのと同じ tool() ヘルパーを使用して関数ツールを定義できます。

import { tool, RealtimeAgent } from '@openai/agents/realtime';import { z } from 'zod';

const getWeather = tool({ name: 'get_weather', description: 'Return the weather for a city.', parameters: z.object({ city: z.string() }), async execute({ city }) { return `The weather in ${city} is sunny.`; },});

const weatherAgent = new RealtimeAgent({ name: 'Weather assistant', instructions: 'Answer weather questions.', tools: [getWeather],});関数ツールは RealtimeSession と同じ環境で実行されます。つまり、セッションをブラウザーで実行している場合、そのツールもブラウザーで実行されます。機密性の高い操作を実行する必要がある場合は、ツールの内部からバックエンドを呼び出し、特権が必要な処理はサーバーに任せてください。

これにより、ブラウザー側のツールをサーバー側ロジックへの薄いバックチャネルとして機能させられます。たとえば、examples/realtime-next では、ブラウザーで refundBackchannel ツールを定義し、リクエストと現在の会話履歴をサーバー上の handleRefundRequest(...) に転送します。そこで別の Runner が別のエージェントまたはモデルを使用して返金を評価し、その結果を音声セッションに返せます。

Hosted MCP ツール

Section titled “Hosted MCP ツール”Hosted MCP ツールは hostedMcpTool で設定でき、リモートで実行されます。MCP ツールの可用性が変わると、セッションは mcp_tools_changed を発行します。MCP ツール呼び出しの完了後にセッションがモデル応答を自動トリガーしないようにするには、automaticallyTriggerResponseForMcpToolCalls: false を設定します。

現在のフィルター済み MCP ツールリストは、session.availableMcpTools としても利用できます。このプロパティと mcp_tools_changed イベントはいずれも、エージェント設定の allowed_tools フィルターを適用した後に、アクティブなエージェントで有効になっている Hosted MCP サーバーのみを反映します。

Hosted MCP のセットアップは、安全なサーバー選択、ヘッダー、承認を接続前の設定として扱うと最も理解しやすくなります。RealtimeSession.connect() がトランスポートを開く前に、SDK はアクティブなエージェントの Hosted MCP ツール定義を解決し、対応している MCP フィールドを Realtime API に送信する初期セッション設定に含めます。

このタイミングは、ブラウザー WebRTC アプリで特に重要です。一時的なクライアントシークレットは常にサーバーで発行されるため、秘匿する必要がある Hosted MCP 認証情報やカスタム headers は、初期 session ペイロードの一部として、サーバー側の POST /v1/realtime/client_secrets リクエストに添付する必要があります。長期間有効な認証情報をブラウザーコードに置いて、connect() 開始後に後から追加する計画にしないでください。

Realtime API レベルでは、後続の session.update 呼び出しでもツールやその他の変更可能なセッションフィールドを変更できます。また、アクティブなエージェントが変わると SDK 自身も session.update を送信します。ただしブラウザーアプリでは、安全な Hosted MCP 初期化をサーバー側の接続前の関心事として扱い、ブラウザー側の RealtimeSession 設定をサーバーが発行した内容と揃えておく必要があります。

バックグラウンド結果

Section titled “バックグラウンド結果”ツールの実行中、エージェントはユーザーからの新しいリクエストを処理できません。体験を改善する 1 つの方法は、ツールを実行しようとしていることをアナウンスするようエージェントに指示したり、ツールを実行する時間を稼ぐための特定のフレーズを言わせたりすることです。

関数ツールがすぐに別のモデル応答をトリガーせずに完了すべき場合は、@openai/agents/realtime から backgroundResult(output) を返します。これにより、ツール出力がセッションに返され、応答のトリガーはあなたの制御下に残ります。

タイムアウト

Section titled “タイムアウト”関数ツールのタイムアウトオプション(timeoutMs、timeoutBehavior、timeoutErrorFunction)は、Realtime セッションでも同じように動作します。デフォルトの error_as_result では、タイムアウトメッセージがツール出力として送信されます。raise_exception では、セッションは ToolTimeoutError を伴う error イベントを発行し、その呼び出しのツール出力は送信しません。

会話履歴へのアクセス

Section titled “会話履歴へのアクセス”エージェントが特定のツールを呼び出した際の引数に加えて、Realtime Session が追跡している現在の会話履歴のスナップショットにもアクセスできます。これは、会話の現在の状態に基づいてより複雑なアクションを実行する必要がある場合や、tools for delegation の使用を計画している場合に便利です。

import { tool, RealtimeContextData, RealtimeItem,} from '@openai/agents/realtime';import { z } from 'zod';

const parameters = z.object({ request: z.string(),});

const refundTool = tool<typeof parameters, RealtimeContextData>({ name: 'Refund Expert', description: 'Evaluate a refund', parameters, execute: async ({ request }, details) => { // The history might not be available const history: RealtimeItem[] = details?.context?.history ?? []; // making your call to process the refund request },});ツール実行前の承認

Section titled “ツール実行前の承認”ツールを needsApproval: true で定義すると、エージェントはツールを実行する前に tool_approval_requested イベントを発行します。

このイベントをリッスンすることで、ツール呼び出しを承認または拒否する UI をユーザーに表示できます。

リクエストは await session.approve(request.approvalItem) または await session.reject(request.approvalItem) で解決します。関数ツールでは、{ alwaysApprove: true } または { alwaysReject: true } を渡して、セッションの残りの間に繰り返される呼び出しに同じ判断を再利用できます。また、session.reject(request.approvalItem, { message: '...' }) を使うと、その特定の呼び出しについてカスタム拒否メッセージをモデルに返せます。Hosted MCP の承認は固定の承認 / 拒否をサポートしません。代わりに、Hosted MCP の allowedTools 設定でそれらのツールを制限してください。

呼び出しごとの拒否 message を渡さない場合、セッションは toolErrorFormatter(設定されている場合)にフォールバックし、その後 SDK のデフォルト拒否テキストにフォールバックします。

import { session } from './agent';

session.on('tool_approval_requested', (_context, _agent, request) => { // show a UI to the user to approve or reject the tool call // you can use the `session.approve(...)` or `session.reject(...)` methods to approve or reject the tool call

session.approve(request.approvalItem); // or session.reject(request.approvalItem);});ガードレール

Section titled “ガードレール”ガードレールは、エージェントが発話した内容が一連のルールに違反したかどうかを監視し、応答を即座に打ち切る方法を提供します。これらのチェックは、エージェント応答の文字起こしストリームに対して実行されます。音声セッションでは、SDK は出力音声の文字起こしと文字起こしデルタを使用するため、重要な前提条件は別のテキスト出力モダリティではなく、文字起こしが利用可能であることです。

提供したガードレールは、モデル応答が返される間に非同期で実行されます。これにより、たとえば「特定の禁止語に言及した」などの事前定義された分類トリガーに基づいて応答を打ち切れます。

ガードレールに抵触すると、セッションは guardrail_tripped イベントを発行します。このイベントは、ガードレールをトリガーした itemId を含む details オブジェクトも提供します。

import { RealtimeOutputGuardrail, RealtimeAgent, RealtimeSession,} from '@openai/agents/realtime';

const agent = new RealtimeAgent({ name: 'Greeter', instructions: 'Greet the user with cheer and answer questions.',});

const guardrails: RealtimeOutputGuardrail[] = [ { name: 'No mention of Dom', async execute({ agentOutput }) { const domInOutput = agentOutput.includes('Dom'); return { tripwireTriggered: domInOutput, outputInfo: { domInOutput }, }; }, },];

const guardedSession = new RealtimeSession(agent, { outputGuardrails: guardrails,});デフォルトでは、ガードレールは 100 文字ごと、および最終的な文字起こしが利用可能になったときに再度実行されます。通常、テキストを話すには文字起こしを生成するより時間がかかるため、多くの場合、ユーザーが聞く前にガードレールが安全でない出力を打ち切れます。

この挙動を変更したい場合は、outputGuardrailSettings オブジェクトをセッションに渡せます。

応答の最後に、完全に生成された文字起こしを一度だけ評価したい場合は、debounceTextLength: -1 を設定します。

import { RealtimeAgent, RealtimeSession } from '@openai/agents/realtime';

const agent = new RealtimeAgent({ name: 'Greeter', instructions: 'Greet the user with cheer and answer questions.',});

const guardedSession = new RealtimeSession(agent, { outputGuardrails: [ /*...*/ ], outputGuardrailSettings: { debounceTextLength: 500, // run guardrail every 500 characters or set it to -1 to run it only at the end },});会話状態と委任

Section titled “会話状態と委任”会話履歴管理

Section titled “会話履歴管理”RealtimeSession は、ユーザーメッセージ、アシスタント出力、ツール呼び出し、切り詰め状態を追跡するローカルの history スナップショットを自動的に維持します。UI にレンダリングしたり、ツール内で検査したり、項目を修正または削除する必要がある場合に更新したりできます。

会話が変化すると、セッションは history_updated を発行します。履歴変更をリクエストする必要がある場合は、updateHistory() を使用します。これは、現在の履歴との差分を計算して必要な削除 / 作成イベントを送信するようトランスポートに要求します。対応する会話イベントが戻ってくると、ローカルの session.history ビューが更新されます。

import { RealtimeSession, RealtimeAgent } from '@openai/agents/realtime';

const agent = new RealtimeAgent({ name: 'Assistant',});

const session = new RealtimeSession(agent, { model: 'gpt-realtime-2',});

await session.connect({ apiKey: '<client-api-key>' });

// listening to the history_updated eventsession.on('history_updated', (history) => { // returns the full history of the session console.log(history);});

// Option 1: explicit settingsession.updateHistory([ /* specific history */]);

// Option 2: override based on current state like removing all agent messagessession.updateHistory((currentHistory) => { return currentHistory.filter( (item) => !(item.type === 'message' && item.role === 'assistant'), );});- 現在、関数ツール呼び出しを後から編集することはできません。

- 履歴内のアシスタントテキストは、

output_audio.transcriptを含む利用可能な文字起こしに依存します。 - 割り込みによって切り詰められた応答は、最終的な文字起こしを保持しません。

- 入力音声の文字起こしは、モデルが音声をどのように解釈したかの正確なコピーではなく、ユーザーが言った内容の大まかな目安として扱うのが最善です。

ツールによる委任

Section titled “ツールによる委任”

会話履歴とツール呼び出しを組み合わせることで、会話を別のバックエンドエージェントに委任して、より複雑なアクションを実行させ、その結果をユーザーに返せます。

import { RealtimeAgent, RealtimeContextData, tool,} from '@openai/agents/realtime';import { handleRefundRequest } from './serverAgent';import z from 'zod';

const refundSupervisorParameters = z.object({ request: z.string(),});

const refundSupervisor = tool< typeof refundSupervisorParameters, RealtimeContextData>({ name: 'escalateToRefundSupervisor', description: 'Escalate a refund request to the refund supervisor', parameters: refundSupervisorParameters, execute: async ({ request }, details) => { // This will execute on the server return handleRefundRequest(request, details?.context?.history ?? []); },});

const agent = new RealtimeAgent({ name: 'Customer Support', instructions: 'You are a customer support agent. If you receive any requests for refunds, you need to delegate to your supervisor.', tools: [refundSupervisor],});次のコードはサーバー上で実行されます。この例では Next.js Server Action を介しています。

// This runs on the serverimport 'server-only';

import { Agent, run } from '@openai/agents';import type { RealtimeItem } from '@openai/agents/realtime';import z from 'zod';

const agent = new Agent({ name: 'Refund Expert', instructions: 'You are a refund expert. You are given a request to process a refund and you need to determine if the request is valid.', model: 'gpt-5.4', outputType: z.object({ reasong: z.string(), refundApproved: z.boolean(), }),});

export async function handleRefundRequest( request: string, history: RealtimeItem[],) { const input = `The user has requested a refund.

The request is: ${request}

Current conversation history:${JSON.stringify(history, null, 2)}`.trim();

const result = await run(agent, input);

return JSON.stringify(result.finalOutput, null, 2);}